就在前几天,2024 年诺贝尔物理学奖颁给了人工神经网络和机器学习,以表彰“利用人工神经网络进行机器学习的基础发现和发明”。简单来讲,人工神经网络是计算机处理大量数据和分析复杂问题的“大脑”,通过节点(也就是“神经元”)之间不同程度的关联来实现程序的处理,随着程序执行,不同节点之间的关联程度会随着节点的活跃变强或变弱,从而获得类似“学习”的过程,并合理地给出我们期望的结果。

毫无疑问,人工智能(AI)在我们社会中的重要性正在逐步增长。现在,AI 模型经常被用来协助人们做出影响生活的重大决策,包括医疗诊断、财务决策、求职招聘等等。

然而,尽管人工智能日益融入社会,我们仍然难以解释人工智能系统为什么会做出这样的决定。AI 模型如何通过大脑扫描来判断大脑是正常还是有一个肿瘤?为什么 ChatGPT 决定输出这一段文字而不是另外一段?在创建有益的人工智能系统时,这些都是需要回答的重要问题。但在回答这些问题之前,首先要解决的一个挑战是关于哲学的问题:我们应该如何解释 AI 系统的决策?解释 AI 的决策又意味着什么?

伦敦国王学院教授哈娜・乔克勒(Hana Chockler)致力于结合哲学和计算机科学的知识,研究解释人工智能系统决策的新方法。正如乔克勒在最近的一次活动上解释的,她和她的团队研发了一种名为 ReX (Responsibility-based Explanations,基于因果的解释)的工具,这个工具可以解释为什么图像标注人工智能模型(称为图像分类器)会以它们使用的这种方式标注图像。她的研究成果可以直接应用于医学影像领域,让医生更好地理解人工智能系统,甚至与人工智能系统互动,由人工智能系统判断大脑扫描结果是否健康。重要的是,使用 ReX 无需了解人工智能系统的内部运作,这使它成为一种通用工具,不仅可以应用于当前的人工智能系统,还可以应用于未来更复杂的人工智能系统。

乔克勒的职业生涯始于计算机科学领域中的形式验证。在这一领域,计算机科学家使用形式数学方法来确定程序是否真的做了我们想要它们做的事情。也就是说,即使验证过程说程序是正确的,我们能确定程序真的做了我们想要做的所有事情吗?“事后看来”,乔克勒说,“这本来就是关于解释的问题:我们如何解释肯定的答案?如何解释没有错误出现?”

在乔克勒攻读博士学位期间,计算机科学家、哲学家约瑟夫・哈尔彭(Joseph Halpern)的一次演讲引起了她的注意。在哲学中,解释结果的问题属于因果关系的范畴。要解释一个结果,我们必须首先知道导致这个结果的原因是什么。一旦我们了解了结果是如何造成的,我们就可以通过给出原因来解释结果。

当时,哈尔彭正在开创一个新的哲学框架来定义因果关系,他称之为实际因果关系。在聆听哈尔彭的演讲时,乔克勒意识到哈尔彭用他的框架解决的问题与她自己正在研究的问题非常相似。唯一不同的是,在她的研究中,需要解释的结果是计算机程序的输出。“这是一个幸运的巧合”,她说,“当时我正在研究纯粹的计算机科学问题,却突然发现这些哲学概念实际上是有用的,这对我来说是一个很大的范式上的转变。”

乔克勒开始与哈尔彭合作,并与她的博士生导师奥尔娜・库普弗曼(Orna Kupferman)一起撰写了一篇论文,展示了她在博士论文中使用的形式验证方法怎么从实际因果关系的角度进行重构。重要的是,他们还介绍了如何量化因果关系或赋予它一个数值,这对她今后的工作非常重要。这种量化的想法将为实际因果关系成为解释大人工智能模型输出结果的强大工具奠定基础。

不过,当时并没有人关注到这项工作。那是在 2002 年,人工智能当时正处于一个不怎么被重视的时期。“没有人明白我们在说什么”,乔克勒回忆道,“每个人都在想,为什么我们突然把哲学引进来了?这是什么鬼话?”

她说,“当然,现在看起来这件事情很滑稽,因为现在每个人都在讨论因果关系。”

什么是因果关系?

为了理解哲学家是如何思考因果关系的,可以想象这样一个场景,外面下着雨,而你正走在回家的路上。当你到家时,从头到脚都湿透了。那么雨水导致你全身湿透究竟是什么意思?

1739 年,苏格兰哲学家大卫・休谟(David Hume)首次定义了因果关系,称为反事实因果关系。根据反事实因果关系,休谟会说:下雨导致你淋雨,因为如果没有下雨,你就不会淋雨。

这样解释存在的一个问题是,它没有考虑到多个重叠原因的可能性。不妨考虑这样一种情况:你走在回家的路上,外面下着雨。这时候,一辆汽车驶过一个水坑,溅了你一身水。当你回到家时,身上又湿透了。

在这种假设下,如果没有下雨,你还是会被汽车打湿。同样,如果汽车没有驶过,你还是会被雨淋湿。因此,雨和车都不是你被淋湿的反事实原因。但可以肯定的是,它们确实是你被淋湿的原因!

实际因果关系

实际因果关系通过拓宽因果关系的概念来解决这个问题。在实际因果关系下,我们可以想象一个假想世界,它在各方面都与现在这个世界一样,只是没有汽车,在这个世界里,雨是你被淋湿的反事实原因,又因为我们可以想象这样一个世界,所以我们说雨可以是你被淋湿的实际原因;同样,我们还可以想象另一个假想世界,这个世界除了没有下雨,其他方面都是一样的,在这个世界里,汽车溅到你身上是你被淋湿的反事实原因。因此,在原来的世界里,汽车溅到你身上也是你被淋湿的一个实际原因。

实际因果关系的一大优势在于,它可以量化原因的重要性。在第一个没有汽车的世界里,雨完全是你被淋湿的原因。在第二个世界中,我们只需要改变可能世界中的一件事(移走汽车),雨就会成为你被淋湿的反事实原因。在这种情况下,雨对你被淋湿有 1/2 的责任。我们可以想象这样一个世界:10 辆汽车驶过,都把你从头到脚溅湿了。在这种不幸的情况下,我们需要改变可能世界中的 10 件事情,雨才能成为反事实原因。因此,我们可以说,雨对你被淋湿负有 1/(10+1) = 1/11 的责任。一般来说,如果我们需要改变可能世界中的 n 件事情才能使一个事件成为反事实原因,我们就说这个事件对结果的责任是 1/(1+n)。

实际因果关系允许我们为不同的原因分配不同程度的责任,从而使我们能够将注意力集中在最重要的原因上。这对于软件工程或人工智能模型等大型系统来说非常重要,因为在这些系统中可能存在许许多多的“原因”。

分析人工智能系统

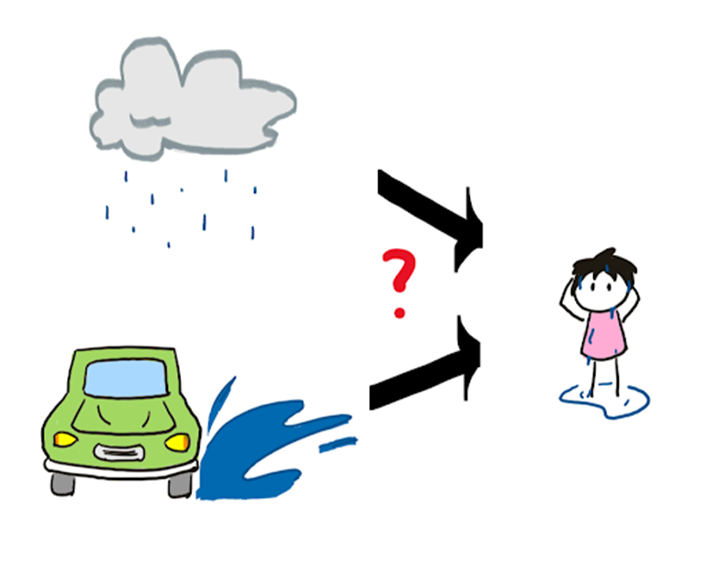

计算机科学家测试人工智能的主要工具之一是图像分类问题。给定一幅图像,人工智能系统如何分辨其内容?

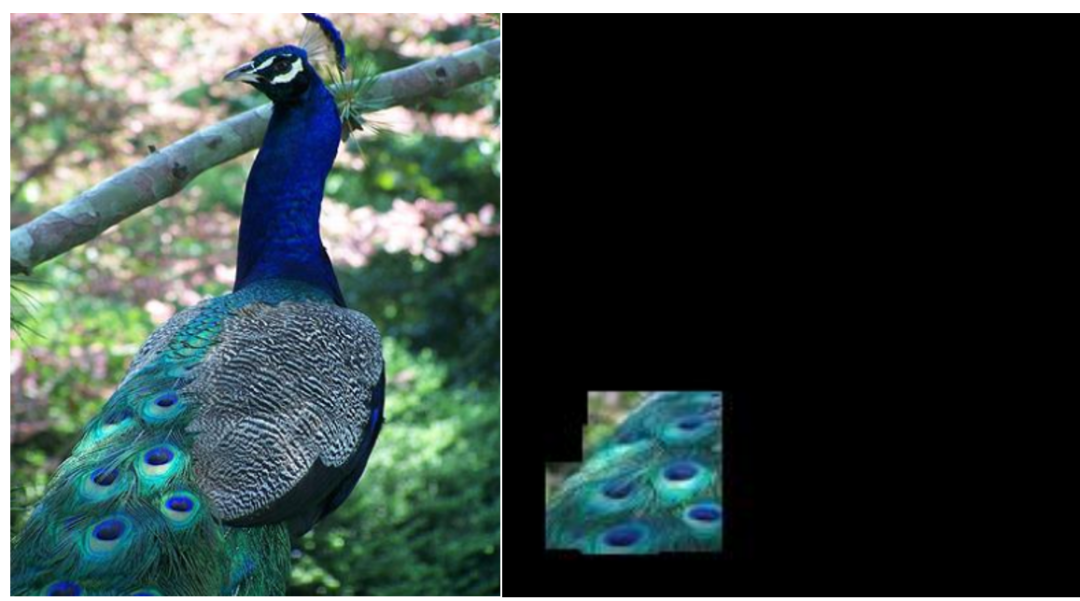

假设人工智能认为图像是一只孔雀,它为什么会做出这样的判断呢?人类可能会解释说,这是一只孔雀,因为它的尾巴上有蓝色和绿色的花纹。乔克勒和她的同事开发的 ReX 工具,从人工智能模型中获得类似的因果解释。对于人工智能模型来说,因果解释是指原始图片的任何部分,其大小都刚好足以识别原始图片的内容。在孔雀图片的例子中,人工智能可能会解释说,它之所以判定图片是孔雀,是因为根据组成尾巴的像素足以做出这样的判定,但任何更小的像素子集都会导致结果是不确定的。

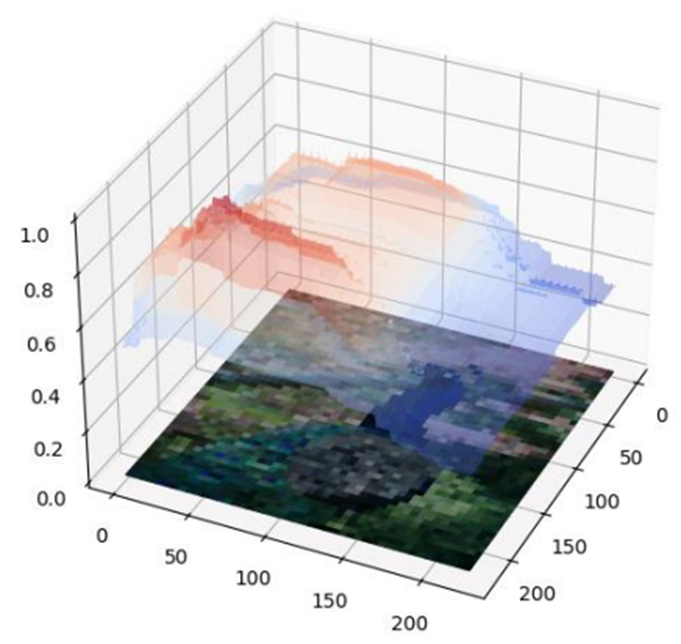

ReX 通过向人工智能模型提供许多与原始图像略有不同的图像,从而从人工智能模型中获得这种因果解释。通过观察人工智能如何对每张略有改动的图像进行分类,ReX 可以很好地估计原始图像的每个像素对人工智能整体决策的影响程度。用实际因果关系的语言来说,它考虑了附近许多不同的假想世界,以估计每个原始像素的权重。在对每个像素点进行估算后,它就会选择足够多的权重最大的像素点,从而将整个图像归类为孔雀图像。

由于实际因果关系是一个适用于任何因果系统的通用哲学框架,因此 ReX 的工作无需了解人工智能系统的内部运作。无论人工智能系统的内部结构如何,只要我们能给它输入信息并读取相应的输出结果,ReX 就能让我们从人工智能中获得解释。正因为如此,它可以应用于我们无法直接理解的过于庞大或复杂的人工智能系统。

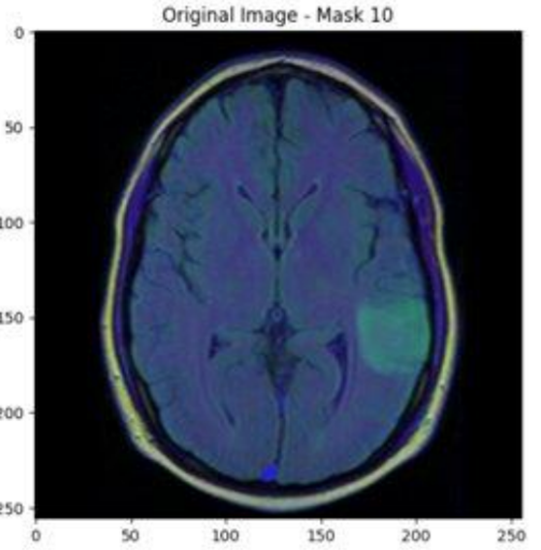

ReX 的一个直接用途是医疗成像领域。当一名疑似脑肿瘤患者接受核磁共振检查时,人工智能系统会自动通过扫描结果判断是否含有肿瘤。如果 AI 认为扫描结果中有肿瘤,就会立即转给医生。如果不是,扫描结果仍会发送给医生,但可能要过几天才能送到医生手中。

有了 ReX,人工智能系统可以响应:"肿瘤在这里!" 这有助于医生更快地进行诊断。ReX 还能解释图像中没有肿瘤的原因。由于肿瘤显示的颜色往往与健康组织不同,ReX 可以生成一个由健康组织颜色像素组成的网格,然后说:“我知道这些组织都是健康的,在这些健康组织之间没有肿瘤。因此,在这次脑部扫描中不可能有肿瘤。如果医生不同意,他们可以告诉人工智能更仔细地检查可疑区域,从而支持医生和人工智能系统之间的对话。”

展望未来

虽然她的工作横跨哲学与计算机科学,但乔克勒坚持认为,她骨子里是一个务实的人。她说:“我对那些我们可以构建、可以验证、可以证明的东西感兴趣。”她的团队的下一个重要目标是将他们的技术应用于大型语言模型,如 ChatGPT。

对于像 ChatGPT 这样的语言模型,存在着图像分类器所不具备的挑战:语言在很大程度上依赖于上下文。在一张猫的图片中,你可以遮住背景,但图片仍然是一只猫,这样你就可以从图片中找到小的子集来代表整个图片。然而,在一个句子或一个段落中,遮住一个 "不" 字可能会完全颠倒整个文本的意思。正因为如此,最小因果解释的概念很难直接套用。乔克勒说:“我们还没有做到这一点,但我们这个团队已经有了很多人,我们对接下来的工作感到非常兴奋。”

作者:Justin Chen

翻译:小聪

审校:7 号机

原文链接:Explaining AI with the help of philosophy

本文来自微信公众号:微信公众号(ID:null),作者:Justin Chen