梦晨 西风 发自 凹非寺量子位 | 公众号 QbitAI

OpenAI公布下一代模型,o1之后直接o3!

“双12”直播活动最后一天,终于来了个大的,奥特曼本人也再次现身直播间。

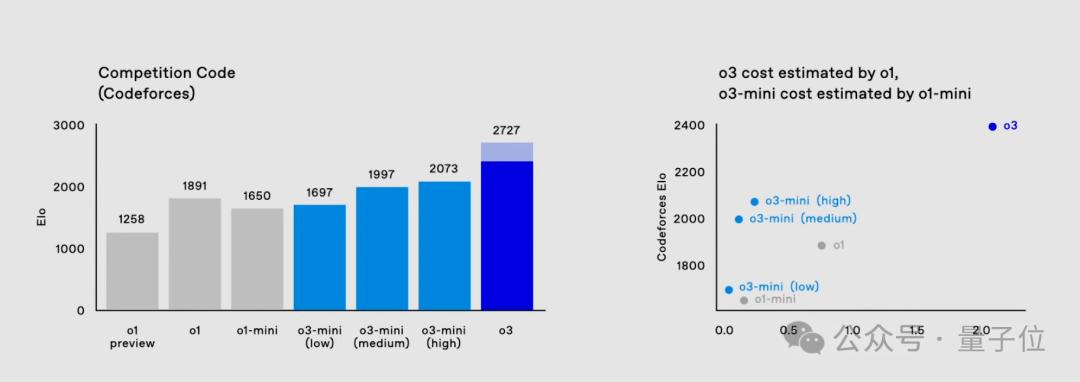

o3相比o1最突出的成绩,一是顶尖程序员竞赛CodeForces分数超过2700,人类超过这个分数的目前只有不到200个。

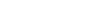

二是在为AGI准备的测试ARC-AGI上分数从32%跃升到了75.7%、87.5%。

为什么有两个成绩呢?

因为o3支持低思考程度和高思考程度两种设置,高思考程度花费的算力(横轴)也直接拉满。

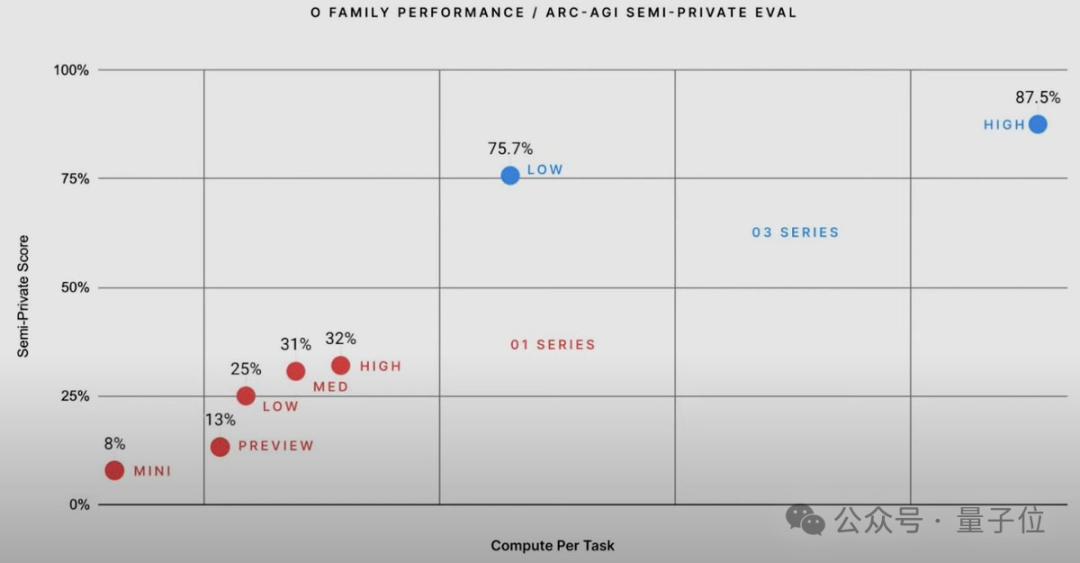

ARC-AGI是Keras之父François Chollet发起的测试基准,典型题目为图形逻辑推理。

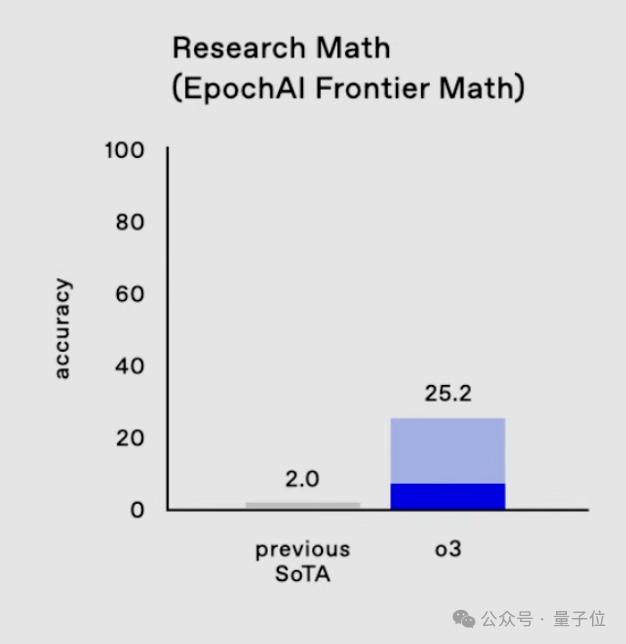

另一项测试是号称最难数学测试的EpochAI Frontier Math,包含最新未公开前沿题目。

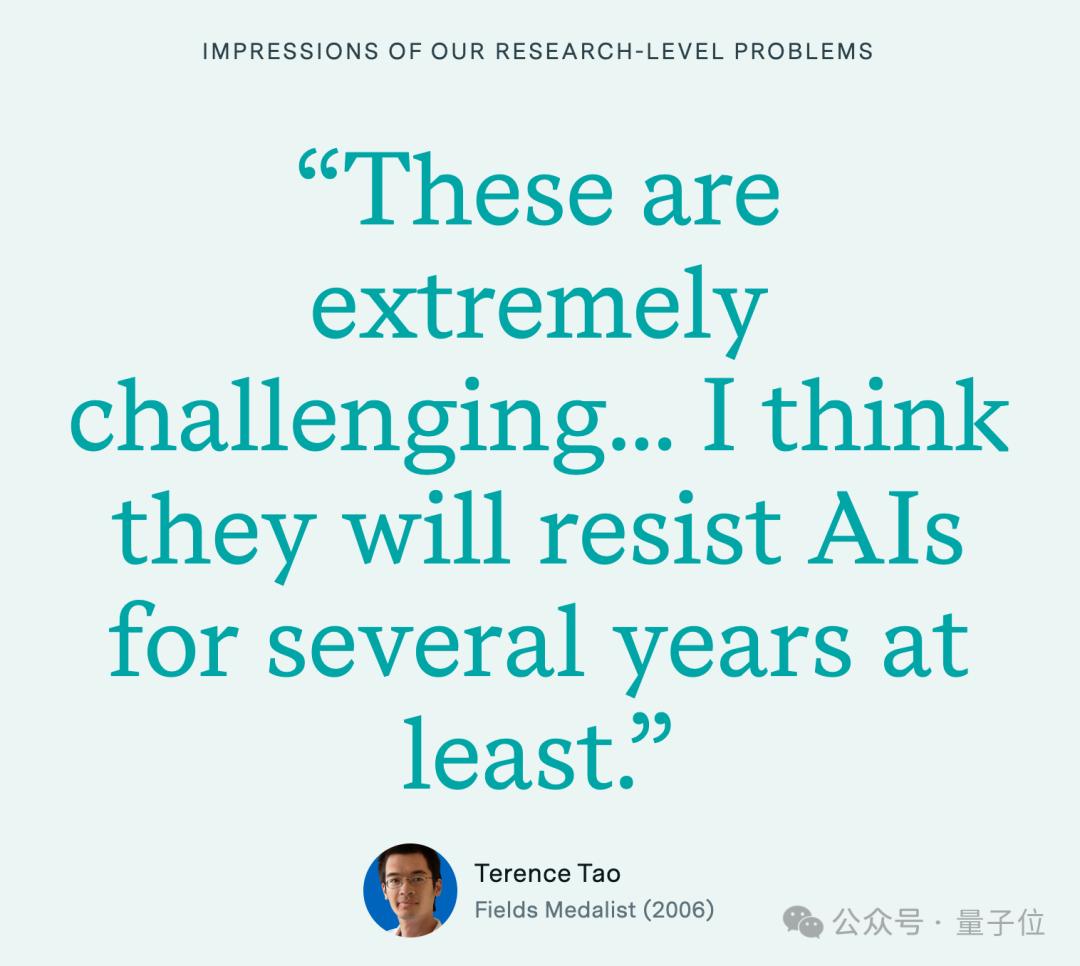

此前陶哲轩对这项测试的第一印象是“可能难住AI好几年”。

o3在测试中比之前SOTA从2分提升到25分。

人类专业数学家解决其中一道题目也要花费数小时到数天,现在o3只需要思考几分钟了。

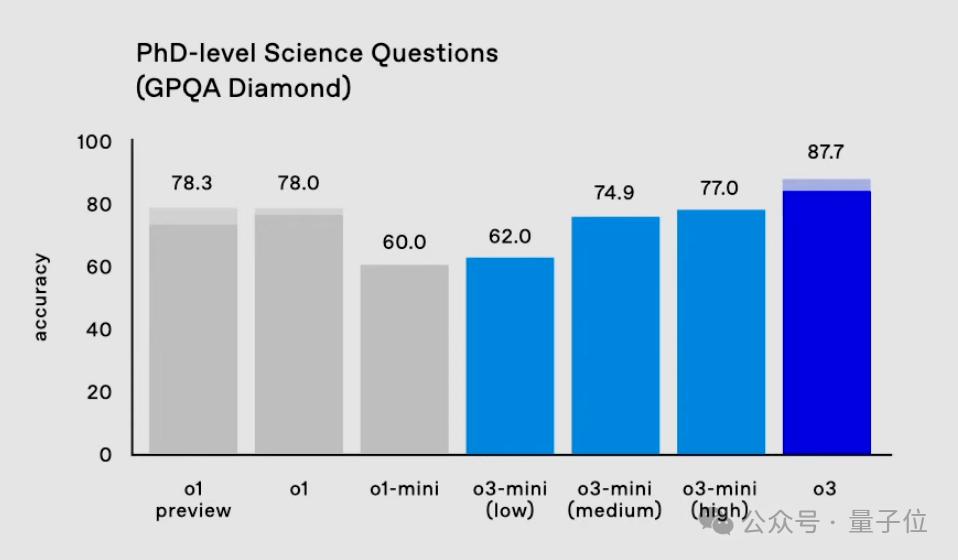

这次直播还公布了o3-mini,支持低中高三种思考程度设置。

主要展示了代码能力,低设置下o3-mini和o1-mini差不多,中高设置已经超过了o1正式版。

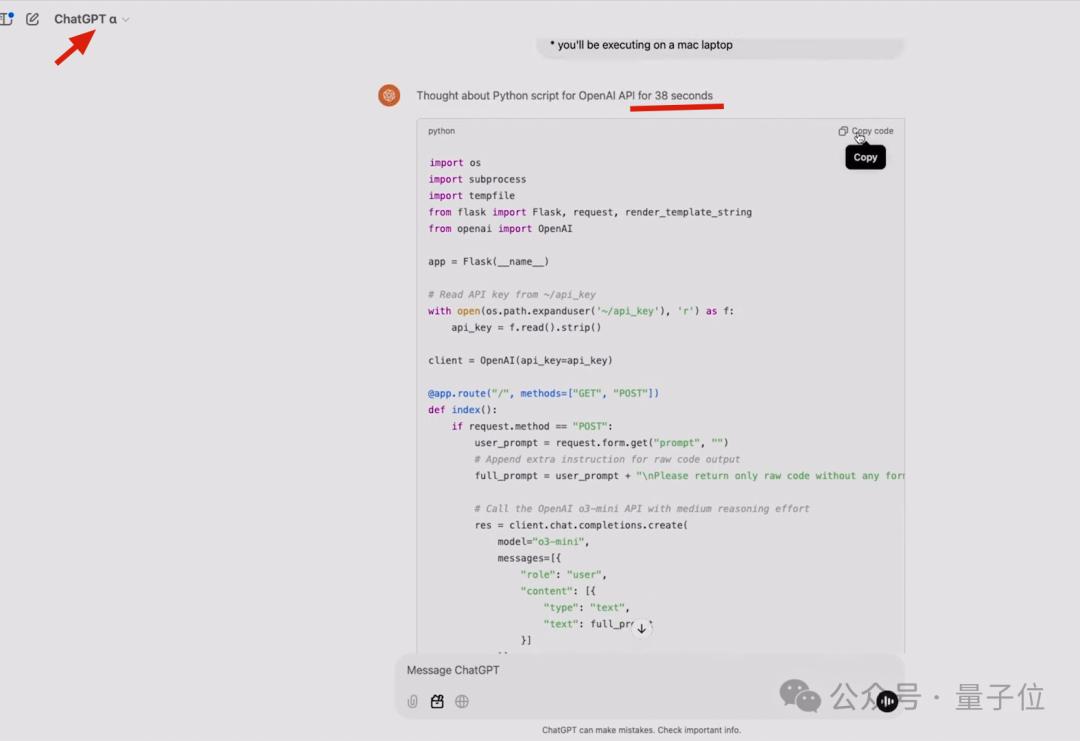

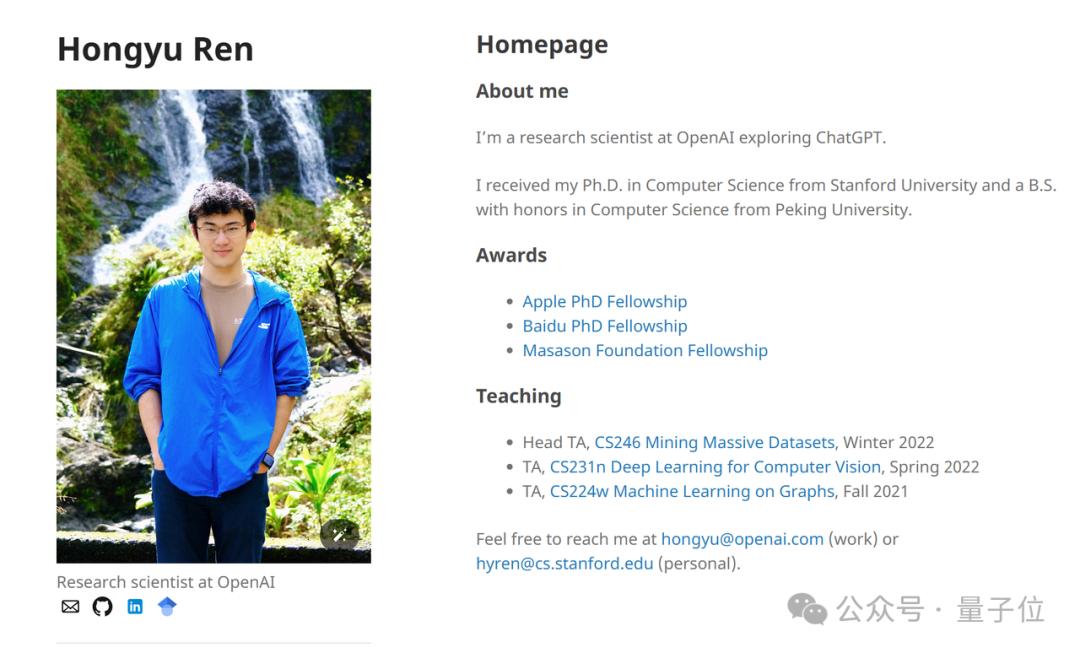

参与研究的北大校友任泓宇,现场展示了o3-mini的编程能力。

他使用了特殊版本的ChatGPT,称为ChatGPT α。

任务如下:

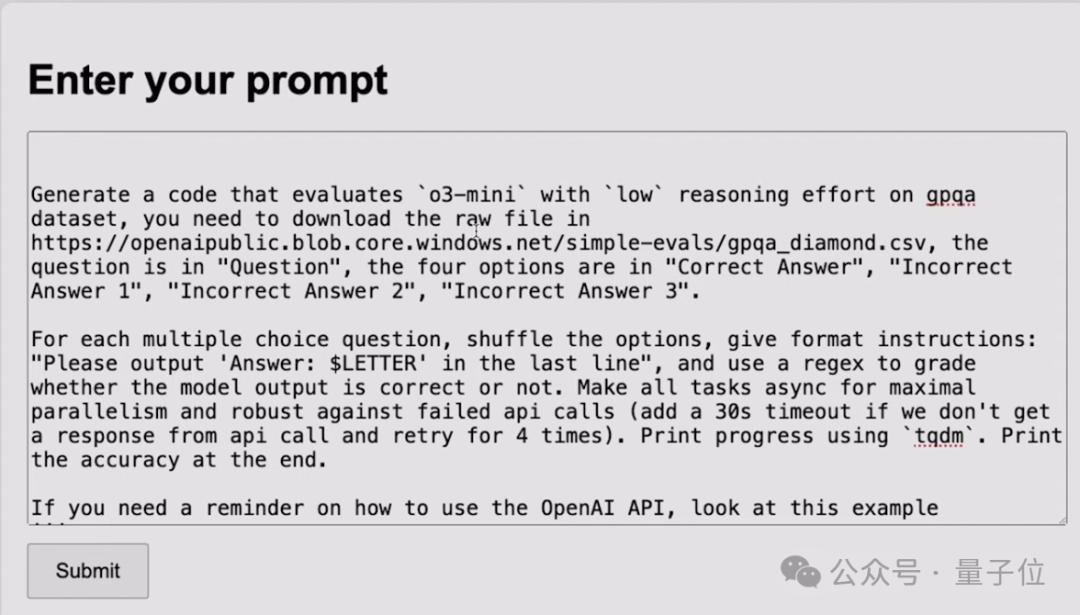

写一个Python脚本,在本地为一个带有大文本框的HTML文件启动服务器。当我在该框中输入文本并按下提交时,它应该将该代码请求发送到OpenAl o3-mini API ,使用medium reasoning_effort ,获取生成的代码,将其保存到桌面上的临时文件中,然后在新的Python终端中执行该文件。还有一些细节:

可以在~/api_key中找到我的API密钥

请在向API的请求中添加一些额外的提示,指定它只应返回没有任何格式或Markdown的原始代码

你将在Mac笔记本电脑环境运行

o3-mini的思考过程用了38秒,然后代码秒出,一次运行成功。

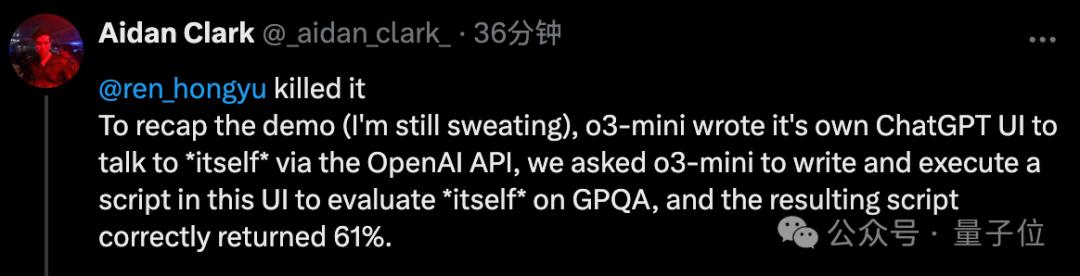

这个演示可能不太直观,但是看得没去现场的另一位OpenAI研究员Aidan Clark直出汗。

总结一下,就是o3-mini用38秒给自己写了一个UI,通过API调用“自己”。

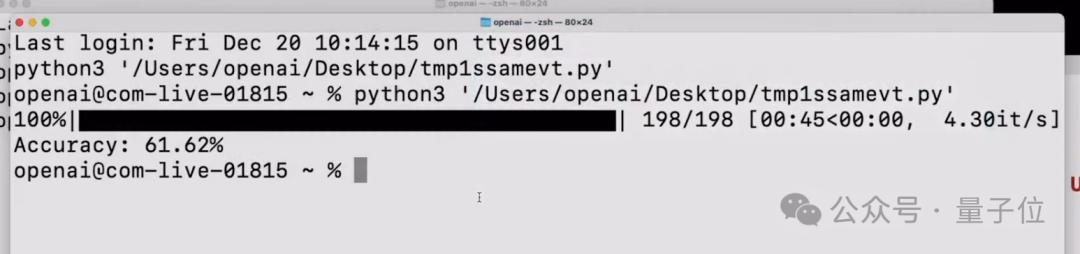

后续演示中,任泓宇要求o3-mini在这个UI中编写并执行一个脚本,来评估“它自己”在低思考程度下、在GPQA数据集上的表现。

脚本正确运行了评估,返回结果数值61.62%,与正式评估结果基本一致。

是不是有一点科幻的感觉了。

可惜呐~ o3和o3-mini目前都是早期预览状态,只给看不给玩。

安全研究者可以在OpenAI官网申请早期访问权限。

北大校友、GPT-4o核心开发者现身直播间

这场直播中另外值得关注的,就是新出场的北大校友任泓宇了(最左边)。

他去年刚加入OpenAI担任研究科学家,主要负责语言模型训练,是GPT-4o的核心开发者、GPT-Next项目组成员。

直播中最新透露,九月份的o1-mini他也有参与,证实了此前传闻中o1-mini主要由三位华人负责(另两位是Kevin Lu和Jiahui Yu)。

任泓宇博士毕业于斯坦福大学。加入OpenAI之前,他在Apple、Google、NVIDIA 和Microsoft有大量研究实习经历。

One More Thing

笑死,最后一天顶着圣诞帽的“青蛙”直接被摆到了最前面:

其实,之前每一场它们都在,不过是被摆在了后面的架子上,而且数量随直播天数增加。

昨天是直播第11天,圣诞帽“青蛙”是酱婶儿的:

你数出来有多少圣诞“青蛙”了吗?

—完—