两款 Step 系列开源多模态大模型,性能位列开源多模态全行业第一。

本周二,国内 AI 创业公司阶跃星辰和吉利汽车集团宣布联合开源两款多模态大模型。

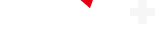

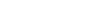

这两款大模型分别是视频生成模型 Step-Video-T2V 和行业内首款产品级开源语音交互模型 Step-Audio。根据官方的测评报告,目前 Step-Video-T2V 是全球范围内参数量最大、性能最好的开源视频生成模型。

Step-Video-T2V 模型部署及技术报告链接:

GitHub:https://github.com/stepfun-ai/Step-Video-T2V

Hugging Face:https://huggingface.co/stepfun-ai/stepvideo-t2v

Modelscope:https://modelscope.cn/models/stepfun-ai/stepvideo-t2v

技术报告:https://arxiv.org/abs/2502.10248

和此前引爆全球科技界的 DeepSeek R1 一样,阶跃星辰的 Step-Video-T2V 视频生成模型,采用最为宽松的 MIT 许可协议,支持免费商用、任意修改和衍生开发,为开源社区带来了新的技术思路启发。这次发布也意味着阶跃星辰成为大模型开源世界的又一股中国力量。

与此同时,两款大模型均已可以在「跃问」App 上进行体验,视频模型还可以在桌面端使用:https://yuewen.cn/videos

阶跃星辰的大模型在 AI 社区引发了关注。Hugging Face 工程师、前谷歌 TensorFlow 团队成员 Tiezhen Wang 表示,阶跃星辰简直就是下个 DeepSeek:

Hugging Face 官推也转贴了他的评论。

GPT-J 作者 Aran Komatsuzaki 贴出了用新模型生成的视频。

更多网友对国内 AI 公司对开源社区的贡献表示了欢迎。

最强开源视频模型

会运镜、生成形象好、还擅长运动

初步体验一下,可以感觉到 Step-Video-T2V 显著提升了视频生成 AI 能力的上限。我们看看目前人们用跃问视频生成的效果。

首先要关注的是在电影、视频短片中最显制作者「功力」的镜头调度能力: