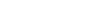

杰弗里·辛顿(Geoffrey Hinton),这位被誉为“人工智能教父”的科学家,于去年获得了诺贝尔物理学奖,引起了全网一阵讨论。

最近辛顿接受了诺贝尔奖官方的专访,他回忆起接到诺奖电话时的趣事时,第一反应竟然是疑惑,因为自己研究的并非物理学(这点和全网的疑惑倒是一样)。

作为深度学习领域的先驱,辛顿最广为人知的成就是神经网络。但很多人其实不知道,他曾说过自己这辈子“最自豪”也是“最失败”的成就,其实是与特里·塞诺夫斯基(Terry Sejnowski)共同提出了玻尔兹曼机理论。

详见:《深度学习之父 Hinton 万字访谈录:中美 AI 竞赛没有退路可言》

他们的工作,以及另一位诺奖物理学奖得主约翰·霍普菲尔德(John Hopfield)等神经网络先驱的早期研究,共同奠定了现代人工智能发展的基础。

采访中,辛顿表达了对人工智能未来发展的担忧。他认为,人工智能可能在短短五年内超越人类智慧,并就此可能引发的社会风险,例如大规模失业和虚假信息等问题,提出了警告。更令人深思的是,辛顿暗示,人工智能的潜在风险可能远超我们目前的认知。

接下来的正文内容,带大家深入了解辛顿的最新观点。

诺贝尔奖:您最初是如何得知自己获得诺贝尔奖的?

杰弗里·辛顿:当时我正好在加利福尼亚一家酒店房间里睡着了,我的手机背面朝上放在床头柜上,并且关掉了声音。因为是侧卧,手机正好在我的视线内。突然,手机屏幕亮了起来。我看到一丝光亮,然后手机开始震动。考虑到加利福尼亚与我认识的几乎所有人所在的东海岸存在时差,我感到疑惑,到底是谁会在这个时候给我打电话?

我拿起手机,屏幕上显示了一个我不认识区号和国家代码的长号码。这时,电话那头传来一个带有瑞典口音的声音,询问我是否是杰弗里·辛顿。接着,他告诉我我获得了诺贝尔物理学奖。

我的第一反应是,等等,我研究的不是物理学啊?这会不会是一个恶作剧?但随后,他所说的内容听起来非常可信。之后,又有其他带有瑞典口音的人加入了通话。这时我才开始相信这是真的。

在接下来的几天里,我仍然感觉像是在做梦。因此,我进行了一些统计学上的推理。我的推理过程是这样的:一个真正致力于研究大脑工作原理的心理学家,获得诺贝尔物理学奖的概率有多大?假设这个概率是两百万分之一,这已经是一个相当宽松的估计了。那么,如果这是一个梦,我梦见自己获得了诺贝尔物理学奖,这个概率又是多少?假设是二分之一。这样一比较,梦境的可能性是现实可能性的百万倍。

因此,我感觉这可能像小时候做过的那些会飞的梦一样——梦里我可以自由飞翔,感觉美妙极了,但醒来后才发现那只是一场梦。过了一个月,我又做了一个会飞的梦。我记得上次做过会飞的梦,但那并不是真的,而这次却感觉如此真实。我当时就想,这次会不会也是这种情况?所以有那么几天,我一直处于一种等待醒来的状态。直到现在,我仍然没有醒来。

诺贝尔奖:在著名的研究人员家庭中长大是怎样的体验?

杰弗里·辛顿:在学术上取得成功的压力一直很大。我从小就隐约地意识到,我必须在学术上有所成就,否则就会被(家族)视为失败。

诺贝尔奖:是什么让您对研究人工智能产生兴趣?

杰弗里·辛顿:我高中时有个朋友,他总是比我聪明得多。大约在我们 16 或 17 岁的时候,有一天他来学校,开始谈论大脑中的记忆,以及它们如何像全息图一样分布在大脑中。

当时全息图刚刚问世,大约是 1965 年。他对心理学家拉什利提出的观点非常感兴趣,即记忆是分散存储在许多神经元中的。我对这个观点产生了浓厚的兴趣,从那时起,我就一直在思考大脑是如何运作的。

诺贝尔奖:人工智能带来的最大风险是什么?

杰弗里·辛顿:人工智能的风险大致可以分为两类:

一类是相对短期的风险,这些风险既重要又紧迫。它们主要源于人们对人工智能的误用。目前,人工智能仍然受人类控制,但已被滥用。这些短期风险包括人工智能取代大量工作岗位,加剧贫富差距。因为当人工智能提高生产力时,收益分配并不均衡。一部分人会失业,而另一部分人则会变得更加富有。这对社会发展是不利的。这是一种风险,我们需要思考应对之策,尽管具体的应对方法尚不明确。

另一种短期风险是虚假视频,它们可能会被用来干扰选举,这种情况已经开始出现。还有网络攻击的风险,一些不良分子可能会利用大型人工智能模型来策划更复杂的攻击。最初可能只是为了更有效地进行网络钓鱼。例如,去年到现在,网络钓鱼攻击事件增加了 1200%,这很可能与大语言模型的出现有关,因为它们使得网络钓鱼更具欺骗性。

此外,人工智能还可能被用于设计生化武器,而且使用人工智能可以更高效地完成这类设计。在不久的将来,设计这类武器可能会变得相对容易,这意味着一个心怀不轨的人就可能制造出难以想象的混乱。如果大模型的参数被公开,情况会变得更加糟糕。因为他人可以轻易获取这些大型模型,并进行微调。而现在已经有人开始公开大模型的参数,我认为这种做法非常不明智。

除了以上风险,还有一些其他的短期风险,例如歧视和偏见。例如,如果你训练一个人工智能模型来决定是否应该给予囚犯假释,而历史数据表明白人囚犯更容易获得假释,黑人囚犯则不然。那么,基于这些历史数据训练出来的人工智能模型,很可能会得出与历史数据相同的结论。但我个人并没有像其他人那样对此感到过分担忧。因为对于人工智能模型,我们可以冻结其参数,并量化其中的歧视程度,这在人类身上是难以做到的。如果我们试图衡量人类的歧视程度,人们会意识到自己正在被评估,从而产生“大众汽车效应”,即他们在被评估时会表现得与平时不同。

因此,我认为在人工智能系统中衡量歧视和偏见,实际上比在人类行为中衡量要容易得多。而且,我认为我们的目标不应该是创造完全没有歧视和偏见的事物。我们的目标应该是创造出相比于现有系统,歧视更少、偏见也更少的人工智能系统。

以上讨论的是短期风险。此外,还存在一个长期风险,即人工智能可能会超越人类并控制一切。我们正在创造比我们自身更智能的实体。对于人工智能超越人类的时间节点,研究人员的看法不尽相同,但在顶尖研究人员中,对于这件事终将发生几乎没有异议,除非人类自我毁灭。因此,问题在于,当我们创造出比我们更聪明的生物时会发生什么?我们对此一无所知,因为之前从未遇到过这种情况。任何断言一切都会好起来或者必然能掌控局面的人,都是疯子。正因如此,现在就进行大量基础研究,探索我们是否能够驾驭比我们更聪明的造物,显得尤为重要。

我们所知的由不够聪明的事物控制更聪明事物的例子并不多。我所知的唯一较好的例子是婴儿对母亲的控制(此处指婴儿的需求和哭闹会影响母亲的行动和决策)。然而,这两者之间的智力差距并不大,而且进化花费了漫长的时间才促成这种情况。

现在,有些人认为这不成问题,因为这些智能体由我们创造,并且我们会以一种确保始终能掌控它们的方式来构建。但是,这些事物会非常聪明,它们会像我们一样,实际上,它们的工作方式与我们非常相似。它们并非像计算机代码那样运作——尽管人们有时将它们称为计算机程序,但它们根本不是传统意义上的程序。你编写计算机程序是为了指导神经网络如何学习,即一个模拟的神经网络。然而,一旦神经网络开始学习,它就会从数据中提取结构,最终形成的系统是从数据中自行构建结构的,而非由人编写的固定程序。我们并不确切知道这种系统会如何运作,而且它们会像我们一样具备自主性。

因此,要让这些系统表现得合理,就像教育孩子一样。我们主要的控制手段在于强化和训练:奖励良好行为,惩罚不良行为。更重要的是,通过展示和示范良好的行为来训练它们,使其观察并模仿。对于这些系统而言,情况也是如此。所以,对它们进行我们期望看到的行为类型的训练至关重要。目前,大型聊天机器人是基于它们所能获取的所有数据进行训练的,这其中甚至包括连环杀手日记之类的内容。试想一下,在养育孩子的过程中,你会让孩子通过阅读连环杀手的日记来学习吗?相信你会意识到那绝对是一个糟糕的主意。

诺贝尔奖:在人工智能超越我们之前,我们还有多少时间?

杰弗里·辛顿:我个人认为,在未来的 5 到 20 年内,我们很有可能,大概有 50% 的概率,会创造出比人类更智能的人工智能。当然,这个时间可能会更长,也可能稍短一些。但我认为在 20 年内,这种情况发生的可能性相当大。其他研究人员对此的预测时间或长或短,这只是我个人的猜测。实际上,这个预测和我一年前的猜测相同。所以,如果现在让我重新猜测,我可能会将时间范围调整为 4 到 19 年。

诺贝尔奖:作为一名科学家,取得成功的重要个人品质是什么?

杰弗里·辛顿:我认为这取决于你所处的领域,以及你是否尝试在研究方向上与领域内的普遍标准有所不同。就神经网络领域而言,很长一段时间里,它都被视为荒谬的,许多人都认为它永远不会奏效。因此,要在这样一个领域取得成功,你必须有自信,坚信自己是对的,即使所有人都认为你是错的。

实际上,我在很小的时候经历过几件事,这对我的成长有所帮助。其中一件是,我的父母都是无神论者,却在我七岁时把我送进了一所基督教私立学校。学校里的每个人都信仰上帝,包括老师和其他学生。但在我看来,这简直是无稽之谈。事实证明,我是对的。这种经历让我体会到,当周围的所有人都相信某件事,而你却清楚地知道他们是错的,并且随着年龄增长,你发现越来越多的人也不再相信他们所相信的,这是一种非常有益的体验。

这对我坚持研究神经网络起到了很大的帮助,即使当时几乎所有计算机科学领域的人都认为神经网络是无稽之谈。当然,并非所有人,但几乎是所有计算机科学领域的人。

另一个我很少提及的经历是,大概在我九岁左右的时候,具体年龄记不太清了。我听到了一个广播节目,我的父亲在节目中谈论大陆漂移学说。在当时,关于大陆是否会移动,存在着很大的争议。几乎所有的地质学家都认为这完全是荒谬的。这个理论最早是由气候学家魏格纳在 1920 年左右提出的,他提供了许多证据来证明大陆是会移动的。但他并非地质学家,因此地质学家们认为他的理论完全是胡说八道,并对此嗤之以鼻。例如,他们拒绝将大陆漂移学说纳入教科书,认为这会误导学生,完全是无稽之谈。

诺贝尔奖:您对年轻研究人员有什么建议?

杰弗里·辛顿:我不确定自己是否适合给出建议,但我通常会给出的建议是:如果你有一个想法,并且你认为它是正确的,但它又与大多数人的看法相悖,那么在你想清楚它错在哪里之前,不要轻易放弃。

因为大多数时候,你所持有的这类与众不同的想法,其实都是错误的。可能是你忽略了某些因素,或者对某些问题理解不够深入。但极少数情况下,你会遇到一个与众不同且正确的想法。除非你坚持自己的信念,不断探索,直到找到它错误的原因,否则你永远不会发现那个正确的想法。同时,你也应该忽略别人的质疑和否定。我很擅长忽略别人的看法。

诺贝尔奖:科学家在社会中有什么责任?

杰弗里·辛顿:我认为,相比于政治家和普通大众,科学家们对人工智能这项技术的本质有着更深刻的理解。当然,科学家之间也存在分歧。仍然有一些科学家认为,这些大型聊天机器人并没有真正理解它们所说的话。尽管有大量的证据表明它们确实具备理解能力,但一些科学家仍然坚持认为这只是一种统计学的技巧。

诺贝尔奖:回顾您的职业生涯,有什么可以做得不同的地方吗?

杰弗里·辛顿:我希望自己能更早地开始关注人工智能带来的生存威胁。我过去一直认为,超级人工智能还很遥远,我们可以以后再考虑这个问题。而当时的首要任务是让这些人工智能变得更加智能。我真希望自己能更早地思考这个问题,即人工智能发展到一定程度后可能会带来什么。

回顾 20 世纪 50 年代初图灵的著作,他谈到了创造比人类更智能的机器。他有一句话,大意是,当然,当机器变得比我们更聪明时,我们就“完蛋了”。他虽然没有明确这样说,但他的话语中暗示了这一层意思。然而,大多数人直到问题迫在眉睫时才开始思考这个问题,而问题是,现在这个问题已经非常接近了。所以我希望自己能更早地开始思考这个问题。

诺贝尔奖:您打算如何使用奖金?

杰弗里·辛顿:我将我个人获得奖金的一半捐赠给加拿大的一个组织,该组织致力于培训原住民社区的居民掌握安全饮用水生产技术。这样做的好处是,接受培训的人们可以留在自己的社区,并为社区提供安全的饮用水。在加拿大这样一个富裕的国家,例如在安大略省,仍然有 20% 的原住民社区无法获得安全的饮用水,这简直是难以置信的。

我对这个问题深有感触,因为我曾在秘鲁收养了一个孩子,并在那里生活了两个月。秘鲁的自来水是不能直接饮用的,它是有毒的。因此,如何获得安全饮用水成为了你生活中的头等大事。这确实给日常生活带来了巨大的额外负担。在加拿大,仍然有人需要遭受这样的困境,这太不应该了。所以我将一半奖金捐给了这个组织。

至于另一半奖金,早在 20 世纪 80 年代,我曾与特里·塞诺夫斯基合作研究玻尔兹曼机理论,特里实际上是霍普菲尔德的学生。我们在玻尔兹曼机理论的研究中贡献相当,可以说,没有与他的交流,就不会有我的理论,反之亦然。特里最初是一名物理学家,后来转向神经科学研究。我们当时认为,玻尔兹曼机一定揭示了大脑的工作原理。

因为它是一个如此精妙的学习算法,我们深信它必然与大脑的工作方式有关。我们甚至认为,我们可能会因为发现大脑的工作原理而获得诺贝尔生理学或医学奖。我们在 20 世纪 80 年代曾达成一个协议,如果诺贝尔奖只颁发给我们中的一人,我们将平分奖金。所以,当诺贝尔奖出乎意料地颁发给我,并且获奖理由之一是玻尔兹曼机时,我立即联系了特里,询问他希望我将属于他的一半奖金寄到哪里。但他表示,他觉得接受这笔钱不太合适,因为这次诺贝尔奖的表彰不仅仅是因为玻尔兹曼机,也包括了其他他参与度较低的后续研究成果。

因此,他拒绝接受这笔钱。最终,我们达成了一个折衷方案,我用我那部分奖金的一半,设立一个以特里·塞诺夫斯基命名的奖项,用于奖励年轻研究人员,特别是那些对大脑工作原理提出“疯狂”理论的年轻研究人员,就像我们当年一样。这个奖项将在我们研究领域的年度会议上颁发。我认为这是一个很好的折衷方案。我认为特里完全有资格成为诺贝尔奖的第三位获奖者,但他最终没有入选。我对此并没有抱怨,但他的确有这个资格。通过设立这个奖项,也是为了肯定他所做出的巨大贡献。

采访视频链接:https://www.youtube.com/watch?v=66WiF8fXL0k